研究内容

本研究は以下3つのテーマに分かれる。まず、光学式と磁気式を併用し、収集されたモーションキャプチャデータの解析を行い、感情表現を抽出する。また、それに合わせ音楽においてもビート解析を行い、文楽の感情表現動作のセグメンテーションを行い部品化する。セグメント化部品化された動作をロボット動作に応用できるように変換する。最後にインタラクション動作デザインを行う。人が感情表現を実際に体感できるように、動作編集を行う。

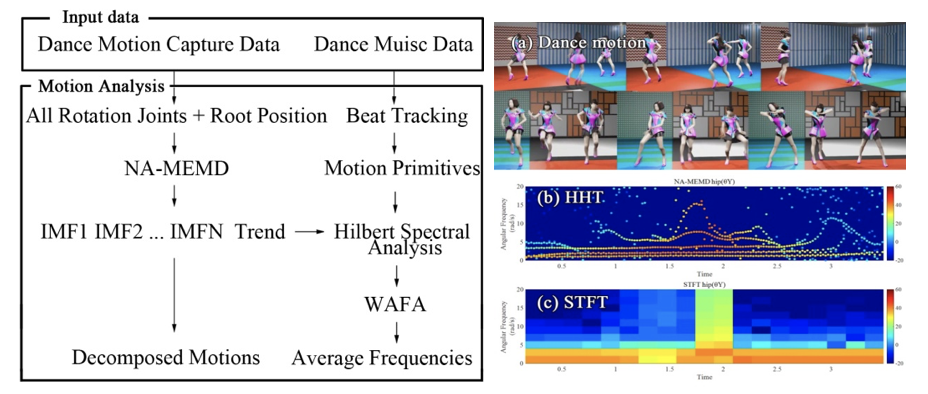

ヒルベルトーファン変換(HHT: Hilbert–Huang transformを用いた周波数領域における高精度動作解析フレームワークを構築できた。ビートトラッキングを同時に行うことにより、動作プリミティブ(所作)をヒルベルトスペクトラムで新たにセグメント化出来るようになり、Perfumeのトレンドから踊りの「構え(基本姿勢)」を抽出し、動作プリミティブ(「振り」)と「かまえ」を新たに分離した。さらに、特にPerfumeの踊りの各モードの平均周波数がフィボナッチ数列のあることを新たに発見(新発見)し、本提案手法の有用性と正確性が今までの研究で示された。

モーションキャプチャでは、人の関節位置にマークを置くことによって、関節の位置だけではなく、回転角度を記録する。ヒルベルトーファン変換は信号を「単色波」である経験的固有モード関数(IMF:Intrinsic Mode Function)及びトレンドに分解し、ヒルベルトスペクトラル解析を行う手法である。約4秒のPerfume 舞踊動作の腰の回転角θYの(b) ヒルベルトスペクトラム、(c) 短時間フーリエスペクトラム図である。図(b、c)では、色はエネルギ、横軸は時間、縦軸は周波数を示す。図のように、ヒルベルトーファン変換は、右足、左足の異なるビートにあわせた高速の回転動作等、5の異なる「所作」(固有モード)を綺麗に捉えている。それに対して、短時間フーリエは時間中央の高速回転部を捉えているに過ぎない。時間―周波数の関係をみる必要のある現象解析において、HHTは短時間フーリエ変換より優位であることは明白である。これは、経験的固有モード分解を行なったのち、ヒルベルト変換が単色の非線形波動(固有モード=「所作」)に対する変換であり、不確定性原理の制約を受けないためである。

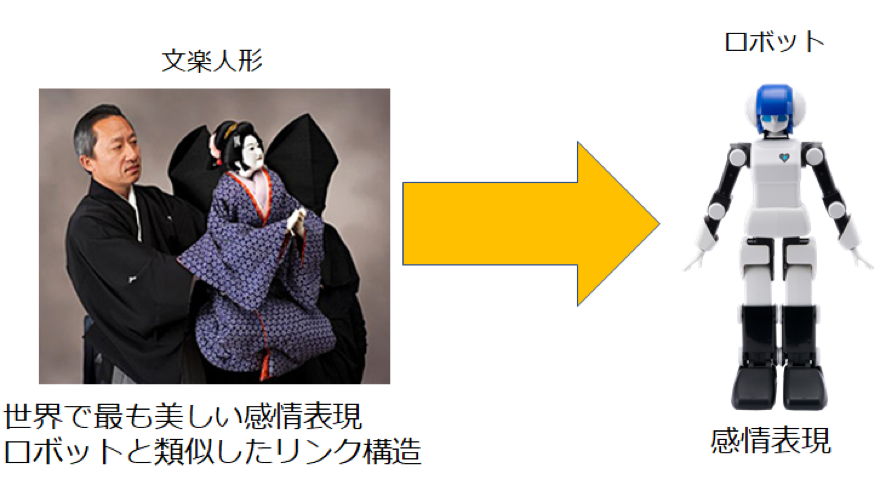

一方、浄瑠璃人形(木偶)は、平安時代からはじまる日本における最古の機械的仕組である。図は文楽の人形カラクリを示した例であり、首、胴体、腕の構造を表している。人形主(おも)遣い(頭部及び右手を操作)は後ろに手を入れ、頭の動き、目の動き、口の動きをコントロールし、感情を表現する。文楽の感情表現は、高度な技術、洗練された技が求められている。例えば、女と男の違いを表現するために、繊細な動作と仕草の違いで表現する必要がある。この日本伝統芸能を解析することによって、ロボットにも感情を持たせるができる。そこで、繊細な動作まで捕らえられるHHTを用いた動作解析手法が最も適切だと考える。

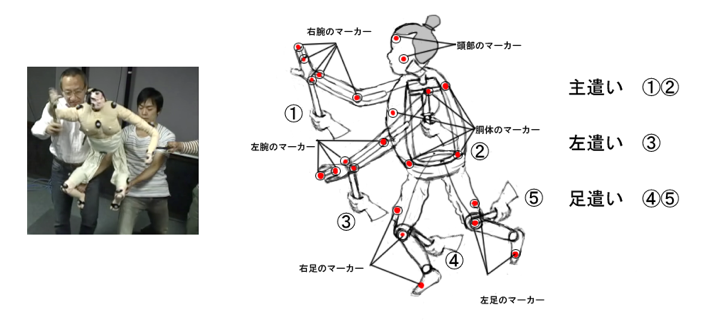

人形からくり、感情表現のメカニズムを解明するため、図のように、モーションと音楽データを劇場で採集する。得られたモーションデータに対してヒルベルトーファン変換解析、音声データに対してビートトラッキングを行う。特に、人間の感情表現と関係する視線誘導、動き(所作)と和音の関係と表現メカニズムを新たに抽出する。 図が示す通り、主使いが頭と右手を、左使いは左手を、足遣いは両足を操作し、3人で一つの文楽人形を操る。人形からくり、感情表現のメカニズムを解明するため、図のように、モーションと音楽データを劇場で採集する。得られたモーションデータに対してヒルベルトーファン変換解析、音声データに対してビートトラッキングを行う。特に、人間の感情表現と関係する視線誘導、動き(所作)と和音の関係と表現メカニズムを新たに抽出する。

本研究で文楽人形の「悲嘆」、「怒り」、「嫌悪」、「期待」、「恐怖」の表現データをすでに取集している。さらに、文楽人形遣い桐竹勘十郎氏(紫綬褒章受章)一座の協力を得て、大阪の文楽劇場で文楽の代表演目「妹背山婦女庭訓」の「道行恋苧環」、「杉酒屋の段」のお杉のモーションデータを取得している。これらのデータから文楽人形の感情表現を高い精度で再現する。

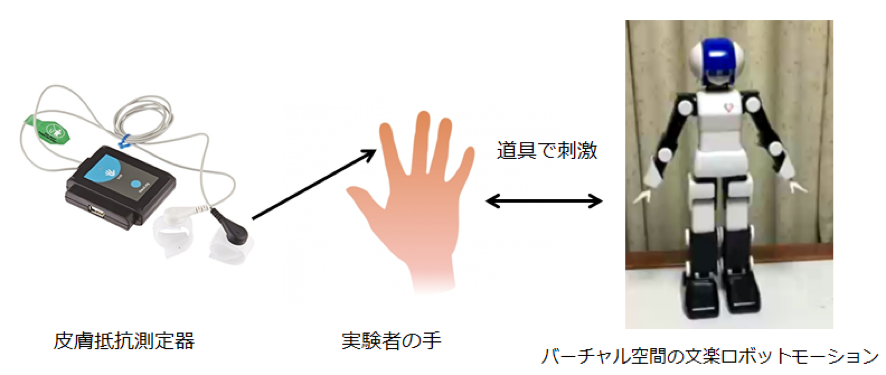

ロボットの感情表現をデザインし、所有感錯覚(Body Transfer Illusion)を用いて、インタラクションデザインデザインを実験で行う。感情移入が起こり、所有感錯覚が触発された際に、皮膚の温度低下などの客観的な評価を用いて検証する。人間が実際にロボットから感情表現を感じられるようなロボット動作デザインを完成させる。